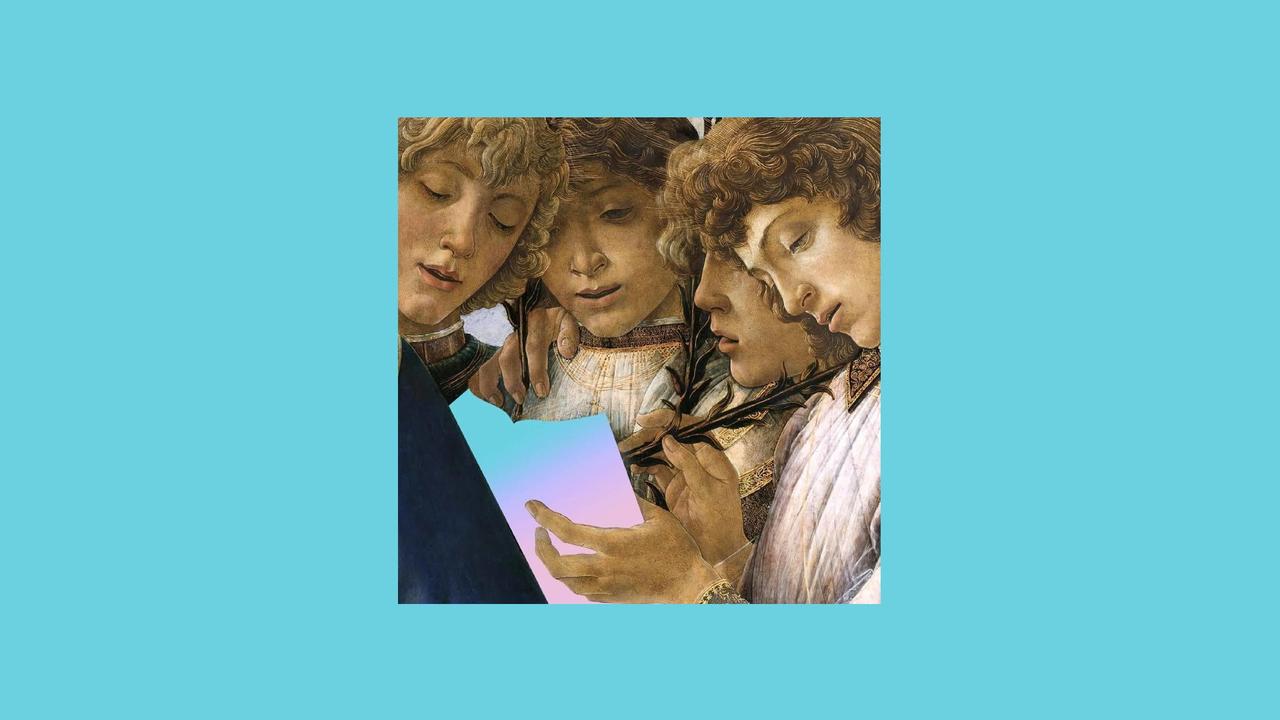

Offenbar brauchen Computer gar kein LSD.

Dass Künstliche Intelligenzen im Bereich der kreativen Medienproduktion eine immer größere Rolle spielen werden, wurde dieses Jahr so deutlich wie vielleicht noch nie. Gerade die Bildplattformen DALL·E 2 und Midjourney haben Community und viele visuelle Artists überrascht und erstaunt. Dass das schon alles geht – noch nie war es so einfach, derart komplexe Bilder zu schaffen, die nur mit Hilfe einer Texteingabe entstanden.

Daraus ergeben sich natürlich viele Fragestellungen. Die der Urheberschaft ist eine der ersten. Aber auch die Art und Weise, wie hier Bilder produziert werden. Bei DALL·E 2 und Midjourney ist nämlich der Prompt, die Texteingabe, die Basis für die Bilder. Ähnlich wie bei Suchmaschinenanfragen muss hier der Kontext geschaffen werden, um das „richtige“ Ergebnis zu erzielen. Außerdem fällt es nicht schwer zu erkennen, dass das erst ein Anfang ist. Derzeit wird viel ausprobiert und der Grat zwischen Nonsens, Meme-Material und Kunst ist hier oft schmal. Es ist indes davon auszugehen, dass solche Systeme auch in anderen künstlerischen Gewerken wie Musik und Soundproduktion immer mächtiger werden und mit hoher Sicherheit kreative Arbeit per se massiv beeinflussen werden.

Was bereits machbar ist, zeigen zahlreiche Fan-Musikvideos, die zuhause zu Songs von Madvillain und Pink Floyd gemacht wurden und auf YouTube verfügbar sind. Aber auch etablierte Artists wie Die Antwoord haben ihre Musikvideos von Algorithmen und Computern machen lassen. Allen gemein ist eine derzeit sehr eigene Ästhetik, die psychedelisch, ja, sehr trippig anmutet. Ich erinnere mich noch an Zeiten, als das Michael-Jackson-Video zu „Black and White“ von 1991 als teuerstes Video aller Zeiten vermarktet wurde und am Ende des Clips die Welt still stand, als die Gesichter ineinander morphten. So eine Bildsprache kann heute offenbar jede/r am eigenen Rechner erstellen. Es ist aber auch davon auszugehen, dass diese spezielle psychedelische Ästhetik mit vermeintlichem Handstrich rückblickend für dieses Jahrzehnt stehen könnte. Zum einen wirkt sie vertraut, wenn man an die flirrenden 60er und 70er denkt. Auf der anderen Seite wohnt diesen Videos eine kalte, obskure Energie inne. Das ist wohl mal wieder das so oft zitierte Uncanny Valley, wenn Maschinen menscheln, aber gerade dadurch Unbehagen produzieren.

In diesem Video gibt es den Song „All Caps“ von Madvillain, das im Stile des Surrealismus von Salvador Dali gehalten wurde. Hier wurde mit Midjourney der Songtext in einzelnen Zeilen visualisiert. Der User Ben Gillin hat die Bilder dann auf den Song passend geschnitten. Die Dichte und Komplexität der Bilder und die Interpretation des Texts sollte den/die Betrachter:in aber nicht unbeeindruckt lassen.

Ebenfalls beeindruckend und besonders trippig sind die Arbeiten von Hueman Instrumentality. Hier handelt es sich offensichtlich um einen Fan von Pink Floyd, und Stück für Stück werden auf dem Account immer mehr Songs der britischen Band visualisiert. Hier sind keine Textprompts die Basis. Die Bewegtbilder funktionieren assoziativer und man merkt auch, dass ein bisschen mehr Arbeit drin steckt. So hat das Rendering von „Time“ ganze fünf Tage gedauert. Gearbeitet wurde mit Stable Warp, und das Bildtraining basierte auf Gemälden von Gregory Euclide. Es gibt also eine eindeutige menschliche künstlerische Referenz – man darf sich aber fragen, was wohl Roger Waters, David Gilmour und Co. damals gedacht hätten, hätte es solche technischen Visualisierungs-Möglichkeiten in den frühen 70ern bereits gegeben. Episch ist aber auch der KI-Film zu dem 16-Minuten-Stück „Echoes“ aus dem Album „Meddle“.

Als letztes Beispiel noch das offizielle Video zu „Age of Illusion“ der südafrikanischen Band Die Antwoord. Das Video stammt von Sagans und nimmt japanische Animes zur visuellen Basis. Auch hier dominieren die Morphs der Bilder die Dynamik des Clips. Es sind also nicht nur Fan-Videos, die durch den Einsatz von KI entstehen.

Wie vorhin gesagt, dürfte das alles bezüglich der technologischen Entwicklung erst ein Anfang sein. Es scheint aber eindeutig, dass die Anwendungen von KI für Film- und Videoproduktionen sich weiter verbreiten werden. Man könnte das als eine Reaktion auf den Smartphone-Social-Media-Doku-Realismus der letzten Jahre verstehen. Zeitgleich ist es aber auch spannend zu sehen, dass gerade Computer, beziehungsweise Algorithmen, die trainiert werden, wie das menschliche Gehirn zu lernen, solche Ergebnisse schaffen. Nicht selten heißt es beim Konsum von LSD, dass man unter Einfluss der psychedelischen Droge die Welt ungefilterter wahrnehmen würde. Dass man Frequenzen erkennen könne, die sonst bewusst vom Gehirn weggedimmt würden. Was wohl Albert Hofmann zu diesen Filmen gesagt hätte? Es dürfte weiterhin fraglich sein, dass Computer in unmittelbarer Zukunft so „intelligent“ wie Menschen werden. Aber man könnte die Meinung teilen, dass durch solche Technologien Prozesse im menschlichen Gehirn besser verstanden werden können. Vielleicht ist der psychedelische Trip viel natürlicher und menschlicher als von vielen angenommen?